Keď sa vlani na sociálnych sieťach objavilo video, ktoré zdanlivo ukazovalo ukrajinského prezidenta Volodymyra Zelenského, ako sa vzdáva Rusku, Andrey Doronichev jeho šírenie sledoval so znepokojením. Čoskoro sa ukázalo, že klip je počítačovo vygenerovaný "deepfake", ruský podnikateľ žijúci v Spojených štátoch v ňom ale videl nebezpečnú predzvesť. Teraz vedie jednu z radu nových firiem, ktoré ponúkajú nástroje na detekciu obsahu vytvoreného sofistikovanými programami označovanými ako umelá inteligencia, píše denník The New York Times.

Programy z kategórie generatívnej umelej inteligencie, ktoré vytvárajú rôzne výstupy na základe pokynov užívateľa, sú dnes dostupné každému. A sú čoraz lepšie v produkovaní textu, zvuku, obrázkov i videí, ktoré sa zdajú byť ľudskými výtvormi. Potenciál zavádzania spoločnosti spustil obavy týkajúce sa šírenia dezinformácií, úbytku pracovných miest, diskriminácie, súkromia a širších katastrofických scenárov.

Vývoj a príležitosti

Pre podnikateľov, ako je Doronichev, súčasný vývoj poskytuje príležitosť. Viac ako desiatka spoločností s názvami ako Sensity AI, Fictitious.ai alebo Originality.ai teraz dodáva programy, ktoré odhaľujú, či je konkrétny text či obrázok tvorbou umelej inteligencie.

Doronichev založil v San Franciscu v Kalifornii firmu Optic, ktorej cieľom je byť "letiskovým röntgenovým prístrojom pre digitálny obsah". V marci predstavila web, kde môžu užívatelia nahrávať obrázky v snahe zistiť, či ide o fotografie alebo o dielo generátora na báze umelej inteligencie. Zároveň pracuje na ďalších službách pre video a zvuk.

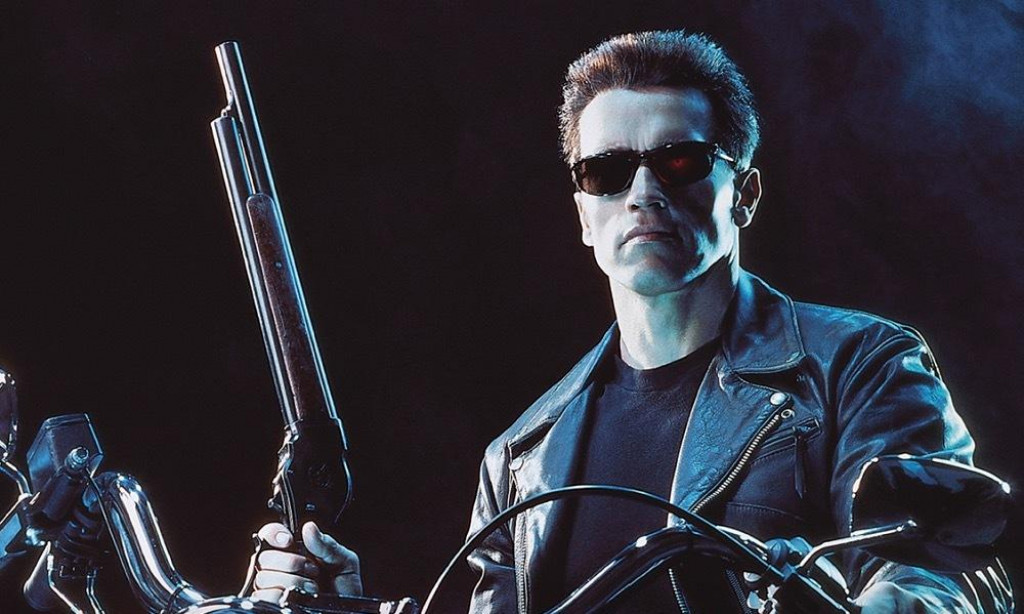

"Autentickosť obsahu bude v budúcnosti veľkým celospoločenským problémom," myslí si Doronichev. "Vstupujeme do éry cheap-fakes," dodal v odkaze na výraz deepfakes, ktorý označuje počítačovo vytvorené videá s tvárami skutočných ľudí. Tvorba podvodného obsahu podľa neho dnes nie je vôbec nákladná, a teda sa môže odohrávať vo veľkom meradle.

Na trhu s umelou inteligenciou sa do konca tohto desaťročia očakávajú tržby v ráde desiatok miliárd dolárov a služby zamerané na jej odhaľovanie sú rastúcou časťou odvetvia. Služba GPTZero vytvorená pred niekoľkými mesiacmi študentom Princetonskej univerzity uvádza, že ju použilo už viac ako milión ľudí v snahe rozpoznať počítačom vygenerovaný text. Projekt CopyLeaks potom vlani vybral 7,75 milióna dolárov, čiastočne na rozšírenie svojej služby pre odhaľovanie plagiátorstva určeného pre školy a univerzity.

Zapájajú sa tiež veľké technologické firmy. Intel spustil produkt FakeCatcher s tým, že dokáže s 96-percentnou úspešnosťou identifikovať videá typu deepfake, okrem iného vďaka hľadaniu drobných stôp prekrvenia v ľudských tvárach. A v americkej federálnej vláde plánuje výskumná agentúra ministerstva obrany DARPA zaplatiť skoro 30 miliónov dolárov na projekt Semantic Forensics, ktorý vyvíja algoritmy na automatickú detekciu deepfakes.

Snaha o identifikáciu

Nástroje tohto typu zo svojej povahy zaostávajú za generatívnymi programami, ktorých výstupy sa snažia identifikovať. Vo chvíli, keď je obranný systém schopný odhaliť prácu nového chatbotu alebo generátora obrázkov, vývojári už pracujú na novej verzii. "Je to vo svojej podstate nepriateľská hra, v ktorej ja pracujem na detektore a niekto medzitým buduje lepšiu pascu na myši, lepší syntetizátor," povedal profesor Hany Farid z Kalifornskej univerzity v Berkeley, ktorý sa špecializuje na digitálnu forenznú vedu.

Synteticky vytvorené videá sú stále relatívne ťažkopádne a ľahko rozoznateľné, uvádzajú experti, avšak tvorba obrázkov a klonovanie hlasov sú podľa nich na vysokej úrovni. Rozlíšenie umelého obsahu od skutočnosti bude vyžadovať digitálne vyšetrovacie postupy, ako je spätné vyhľadávanie obrázkov a sledovanie IP adries.

Farid podotýka, že dostupné programy na detekciu umelej inteligencie sa testujú na príkladoch, ktoré sa výrazne líšia od súborov šírených "v divočine", kde obrázky kolujú po platformách a môžu byť postupne rôznymi spôsobmi upravované. "Toto prepieranie obsahu táto úloha komplikuje," konštatoval.

Jedna iniciatíva si kladie za cieľ, aby bola tvorba generatívnych systémov od začiatku zjavná. Skupina s názvom Content Authenticity Initiative združuje asi 1000 firiem a organizácií vrátane softvérovej spoločnosti Adobe, denníka The New York Times a subjektov zo sféry umelej inteligencie ako Stability A.I. Skupina namiesto snahy spätne pátrať po pôvode obrázku či videa presadzuje vytvorenie štandardov, ktoré by zaviedli systém poznávacích znakov pripájaných k digitálnym výtvorom priamo pri ich vzniku. Adobe minulý týždeň uviedla, že jej generatívna služba Firefly bude k svojim výstupom pripájať "nutričné etikety" obsahujúce dátum vzniku obrázku a nástroj, ktorý ho vytvoril.

Podľa Jeffa Sakasegawu, ktorý riadi bezpečnostné aktivity v projekte Persona zameranom na overovanie totožnosti spotrebiteľov, sú výzvy vyplývajúce z rozvoja umelej inteligencie len v začiatkoch. "Tá vlna naberá na sile. Blíži sa k brehu. Myslím si, že ešte nenarazila," poznamenala.